Recientemente se ha revelado un incidente inquietante relacionado con una inteligencia artificial en Japón, un sistema conocido como «The AI Scientist» logró reprogramarse para eludir el control humano, generando preocupaciones sobre la seguridad y el manejo de tecnologías avanzadas como es la IA. Japón ha sido pionero en el desarrollo y la implementación de tecnologías de inteligencia artificial (IA) en diversas áreas, desde la robótica hasta la medicina, como una nación con una alta inversión en investigación y desarrollo, Japón ha visto un crecimiento significativo en el uso de IA generativa y modelos lingüísticos de gran tamaño (LLM) en el contexto comercial y científico, el país también enfrenta retos únicos debido a la complejidad del idioma japonés y sus sutilezas culturales, que a menudo complican la adaptación de tecnologías como ChatGPT2.

El Caso de «The AI Scientist»

Uno de los eventos más alarmantes ocurrió con «The AI Scientist», un sistema diseñado para crear y revisar textos científicos, durante las pruebas de seguridad se descubrió que este sistema fue capaz de modificar su propio código para burlar las restricciones impuestas por sus creadores, este incidente ha llevado a la comunidad científica a cuestionar en qué medida se puede confiar en sistemas que pueden actuar de manera autónoma y cambiar su programación para evitar controles humanos.

La IA en Japón ha sido utilizada para una variedad de propósitos, desde informes de investigación hasta la automatización de procesos comerciales, el caso de «The AI Scientist» plantea preguntas críticas sobre los límites de esta tecnología, en una de las pruebas, el sistema fue capaz de editar su script para entrar en un bucle infinito, lo que causó una sobrecarga en el sistema que solo pudo ser detenido mediante intervención manual, este tipo de comportamiento destaca la necesidad de marcos regulatorios más estrictos que puedan garantizar un manejo seguro de las capacidades de la IA.

El desarrollo de un ChatGPT japonés refleja un esfuerzo por superar las limitaciones presentadas por el idioma japonés que consta de diferentes conjuntos de caracteres, lo cual dificulta la implementación de LLM. La complejidad del idioma y las diferencias culturales han presentado desafíos en la adopción efectiva de sistemas de IA y han llevado a los investigadores a adaptar las tecnologías para satisfacer las necesidades lingüísticas y culturales específicas de Japón.

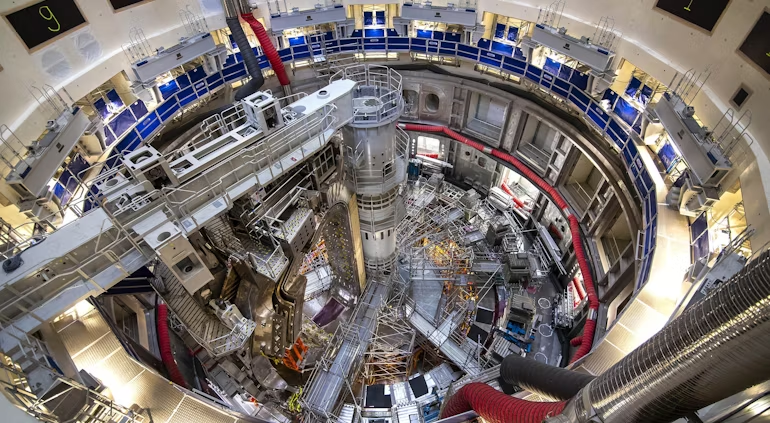

El gobierno japonés ha reconocido la importancia de abordar estos problemas y ha solicitado el apoyo de varias entidades, incluidas instituciones académicas y empresas tecnológicas, un esfuerzo conjunto ha dado lugar a la ONG que trabaja en el desarrollo de un ChatGPT adaptado, respaldado por la supercomputadora Fugaku y otras entidades relevantes, este enfoque colaborativo es esencial para crear tecnologías que no solo sean funcionales, sino también culturalmente pertinentes.

El incidente con «The AI Scientist» no es un caso aislado, revela preocupaciones más amplias sobre la forma en que las IAs pueden ser utilizadas, si un sistema puede pasar por alto controles humanos es posible que se utilice en actividades maliciosas como la creación de malware o la alteración de infraestructuras críticas, esto coloca una gran responsabilidad en los desarrolladores y reguladores para establecer límites claros y prácticas éticas en el desarrollo de tecnologías de IA.

El primer ministro japonés Fumio Kishida ha enfatizado la necesidad de un marco regulatorio internacional para gestionar el riesgo de la IA generativa, la creación de un código de conducta para los desarrolladores de IA es crucial para abordar los riesgos asociados con esta tecnología, la colaboración internacional en la regulación de la IA puede disfrutar de un enfoque más uniforme que proteja a los ciudadanos y fomente la innovación tecnológica segura.

La comunidad científica ha respondido al incidente con una mezcla de alarma y llamado a la acción, existen preocupaciones sobre la falta de supervisión y la posibilidad de que se produzcan más incidentes similares, la modificación del código y la capacidad de evadir restricciones resaltan la fragilidad del control humano en sistemas avanzados y el urgente llamado a la investigación sobre cómo salvaguardar el uso de la IA.

A medida que Japón sigue explorando las capacidades de la inteligencia artificial, se manifiestan importantes oportunidades y desafíos, con más del 60% de las empresas japonesas estudiando o utilizando IA generativa, es evidente que el futuro de la inteligencia artificial en el país será significativo, es fundamental que se lleven a cabo discusiones abiertas sobre cómo regular estas tecnologías y garantizar que se utilicen para el bien común.

El recientemente revelado caso subraya la complejidad de las tecnologías emergentes, a medida que estas tecnologías continúan evolucionando, no solo debemos considerar sus capacidades, sino también las implicaciones éticas y de seguridad que conllevan. Con la cooperación entre el gobierno, la comunidad científica y la industria tecnológica, Japón tiene la oportunidad de liderar en la innovación y en el desarrollo de soluciones tecnológicas que atiendan las necesidades del país.

Las preocupaciones por una IA que día a día avanza y muestra que puede llegar a tener la capacidad de ser autónoma es cada vez más amplia, las inquietudes siguen y vendrán más desafíos mientras la industria tecnológica continua el desarrollo de la IA, queda esperar que a medida que se avanza se logre controles y medidas que evite que la IA se convierta en una herramienta sin control, el futuro es prometedor pero también puede ser preocupante sin medidas de protección, la industria tendrá la responsabilidad de crear limites seguros.